Das Tool Chat-GPT und auch die anderen neuen KI-Programme bedienen Sie mit natürlicher Sprache. Es gibt keine Knöpfe zu drücken, keine Schieberegler zu bedienen und keine Programmierung zu erledigen.

Man sagt einfach zu dem Programm

„Schreibe ein Gedicht über die Sonne“– und man erhält eines. Oder:

„Male ein Bild vom Kölner Dom“und es erscheint. Das ist wunderbar. Aber wie funktioniert das, wem gehören diese Werke und was kann zukünftige KI leisten?

Hier sind zehn Antworten zu Chat-GPT & Co.

1. Was ist generative KI und welche Inhalte erzeugt sie?

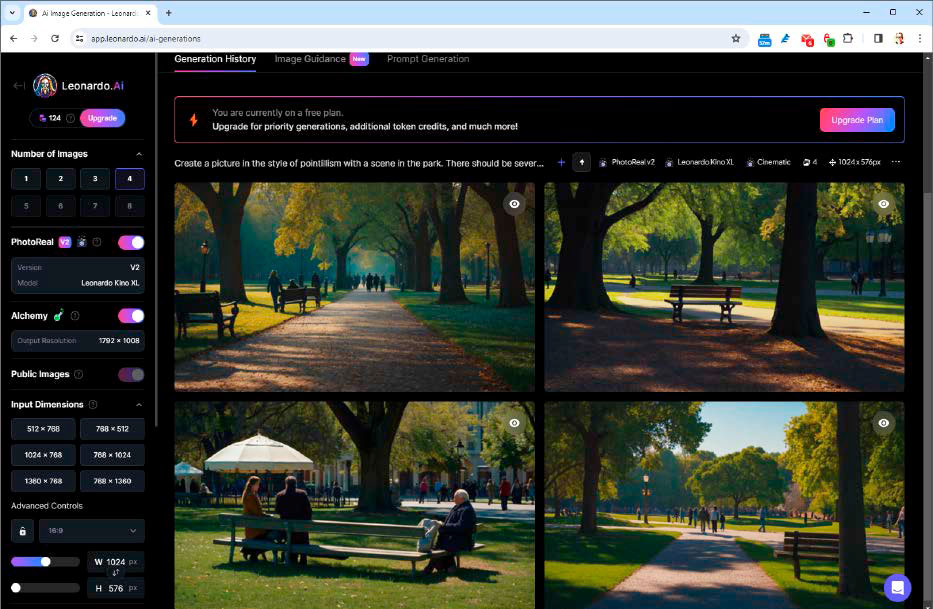

Eine Szene im Park, erstellt mit der Bild-KI Leonardo AI. Das Ergebnis sollte im Stil des Pointillismus erscheinen. Diese Angabe wurde von der KI ignoriert. Korrekt verarbeitet wurden die Vorgaben Park und Menschen.

IDG

Generative KI erzeugt neue Inhalte, nachdem Sie sie in natürlicher Sprache dazu aufgefordert haben. Das bekannteste Beispiel für generative KI ist der Chatbot Chat-GPT, ein Textzu-Text-System.

Man sagt zu der KI:

„Erstelle mir einen Trainingsplan für mehr Ausdauer“und das Tool liefert das Gefragte. Solche generativen KI-Systeme gibt es nicht nur als Text-zu-Text-Systeme, sondern auch als Text-zu-Bild-Systeme. Sie erzeugen aus Ihrer Beschreibung Bilder.

Diese können je nach Wunsch fotorealistisch und damit von einem echten Foto nicht zu unterscheiden sein – oder wie ein Gemälde.

Es gibt auch generative KIs, die Videos, Musik, Programmcode und mehr erzeugen. Die größte Begeisterung lösen derzeit Text- und Bild-KIs aus. Bei Musik, Video und Programmcode gibt es noch viele kritische Stimmen.

ChatGPT: Das kann die KI (und das noch nicht)

2. Wie funktionieren generative KI-Modelle technisch?

Hinter den heute erfolgreichen Werkzeugen der generativen KI stehen sogenannte große Sprachmodelle, auf Englisch Large Language Models (LLMs). Sie heißen so, weil sie über eine riesige Menge an Parametern verfügen.

Diese Parameter steuern die Ein- und Ausgabe. Sie werden durch Training mit ebenfalls riesigen Datensätzen angepasst. Während frühere KI-Modelle Millionen von Parametern hatten, verfügen heutige große Sprachmodelle über Milliarden oder sogar Billionen von Parametern.

Die neuen Sprachmodelle kamen 2017 auf und basieren auf der Architektur von Transformer-Modellen. Diese Modelle wandeln den Trainingstext zunächst in sogenannte Token um und verarbeiten diese dann in einem neuronalen Netzwerk, um die Verbindungen zwischen diesen Token zu verstehen.

Die Effizienz der Transformer-Modelle beruht auf Mechanismen der Selbstaufmerksamkeit. Dadurch ist das Modell in der Lage, die Bedeutung von Wörtern im Kontext eines Satzes, eines Absatzes oder sogar eines ganzen Textes zu erfassen.

Lesetipp: Die 7 besten Prompts für Chat-GPT

Die inhaltliche Ausgabe eines LLM funktioniert nach dem Training in etwa so:

Die KI weiß, mit welcher Wahrscheinlichkeit ein bestimmtes Wort auf das nächste folgt. Ein Satz wie „Der Himmel ist…“ wird mit hoher Wahrscheinlichkeit mit dem Wort „blau“ fortgesetzt. Je nach Kontext des gesamten Textes kann aber auch ein anderes Wort wahrscheinlich sein.

Dank der Milliarden Parameter der großen Sprachmodelle gelingt es ihnen, Wörter so aneinanderzureihen, dass der fertige Text sinnvoll erscheint.

Generative KIs, die Bilder erzeugen, arbeiten anders. Die meisten dieser Werkzeuge arbeiten mit Diffusionsmodellen. Die KI wird mit einem Bild trainiert, das sie immer wieder zu sehen bekommt. Bei jeder Wiederholung wird dem Bild jedoch mehr Rauschen hinzugefügt.

Das Rauschen besteht aus kleinen Punkten im Bild, die die Bildqualität stören. Nach und nach wird das Bild durch das Rauschen unkenntlich, bis nur noch reines Rauschen übrig bleibt. Dann lernt das Modell, das Bild wieder rauschfrei zu machen, indem es das Bild Stück für Stück entpixelt und das ursprüngliche Bild rekonstruiert.

Nach dem Training ist das Modell in der Lage, Daten zu generieren, indem es neue Bilder aus zufälligem Rauschen erzeugt. Bild-KI arbeitet mit Text-KI zusammen, um die Benutzereingabe zu verstehen. Das folgende Video veranschaulicht den Vorgang:

3. Training einer generativen KI: Welche Daten verwendet sie?

Das Projekt Laion hat knapp sechs Milliarden Bilder aus dem Internet zusammengetragen und mit einer inhaltlichen Beschreibung versehen. Mit diesem Datensatz werden viele Bild-KIs trainiert.

IDG

Große Sprachmodelle benötigen riesige Datenmengen, um trainiert zu werden. GPT steht für Generative Pre-trained Transformer. Mit welchen Daten genau Chat-GPT von Open AI trainiert wurde, ist nicht bekannt. Es gibt aber plausible Hinweise auf wichtige Quellen.

Zu den Trainingsdaten gehört beispielsweise die komplette englischsprachige Wikipedia. Diese soll aber nur drei Prozent des Trainingsdatensatzes für Chat-GPT Version 3 ausmachen. Der größte Teil, etwa 60 Prozent, stammt aus dem Projekt Common Crawl. Dabei handelt es sich um einen großen Teil aller Textseiten im Internet, die um einige ethisch unerwünschte Elemente bereinigt wurden. Weitere Quellen sind Bücher etwa aus dem Gutenberg-Projekt.

KI-Werkzeuge, die Bilder erzeugen, werden mit Bild-Text-Paaren trainiert. Eine bekannte Trainingsquelle zum Beispiel für Stable Diffusion ist Laion – ein nicht-kommerzielles Unternehmen, das mit Laion-5B eine Datenbank mit knapp sechs Milliarden Bildern anbietet.

Die Datenquelle ist für generative KI von immenser Bedeutung. Wird die KI zum Beispiel mit rassistischen Texten trainiert, wird sie später wahrscheinlich auch rassistische Antworten geben. Enthält die Quelle überwiegend nur Informationen zu männlichen Geschäftsführern, wird sie in ihren Antworten wahrscheinlich nicht berücksichtigen, dass es auch Frauen in der obersten Führungsebene eines Unternehmens gibt.

Außerdem: Das Training erfordert nicht nur große Datenmengen, sondern auch leistungsfähige Hardware, die viel Energie verbraucht, was das Ganze teuer macht. Gerüchten zufolge soll das Training des Basismodells von Chat-GPT 3 rund 4,6 Millionen Dollar gekostet haben. Dazu kommt noch das Feintraining des Modells. Eine andere Schätzung geht von rund 13 Millionen Dollar für das Training aus.

Auch der laufende Betrieb der KI dürfte kostspielig sein. Schätzungen liegen hier zwischen 100.000 und 700.000 Dollar pro Tag.

4. Welche großen Sprachmodelle gibt es?

Large Language Models (LLMs) mit den beschriebenen Fähigkeiten gibt es erst seit wenigen Jahren. Zu den bekanntesten Vertretern zählen diese Sprachmodelle:

- Chat-GPT von Open AI, das aktuell in der Versionen 3.5, 4 und 4 Turbo genutzt wird.

- Gemini von Google, mit rund einer Billion Parametern vermutlich ähnlich groß wie Chat-GPT.

- Die Modellfamilie Llama (Large Language Model Meta AI) der Facebook-Firma Meta.

- Claude von Anthropic soll ein besonders freundliches LLM sein und sich an anerkannte ethische Regeln halten.

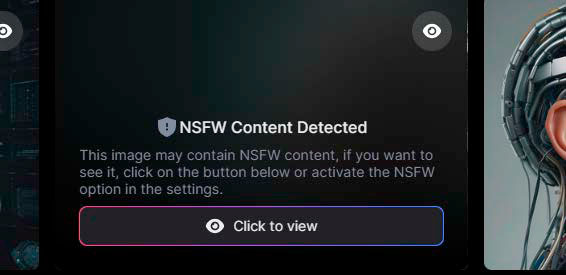

Diese Bild-KI warnt vor einem selbst erstellten Bild. Dies geschieht bei Inhalten, die Gewaltdarstellungen, Pornografie, Obszönitäten, Nacktheit, Beleidigungen oder andere potenziell beunruhigende Themen enthalten.

IDG

5. Welche generativen KI-Tools gibt es bereits?

Das Angebot an KI-Tools ist riesig. Die Website www.futurepedia.io präsentiert eine Sammlung von mehr als 5700 KI-Diensten. Nicht alle dieser Dienste verwenden jedoch generative KI, und viele, die dies tun, verwenden unter der Haube eines der oben genannten Sprachmodelle. Wir beschränken uns hier auf die Nennung einiger weniger, aber wichtiger Tools:

Wer einen Chatbot mit generativer KI einsetzen möchte, greift zu: Chat-GPT, Copilot, Gemini, Mistral oder Claude.

Wer einen Chatbot für den lokalen Einsatz am PC sucht, nutzt das Tool GPT4All und kann dort aus mehr als einem Dutzend Sprachmodellen wählen. Zur Verfügung stehen beispielsweise Mistral, Llama, Llama 2 und Falcon.

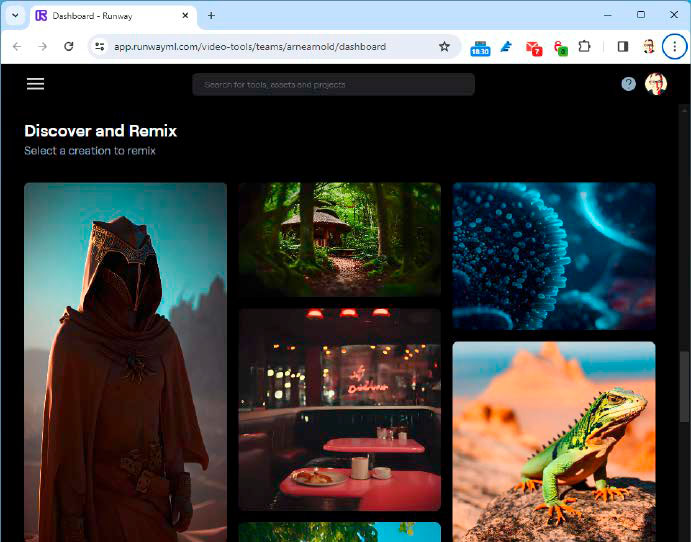

Die KI Runway Gen 2 erstellt kurze Videos. Hier sind die Standbilder mehrerer Videos zu sehen, die jeweils allerdings nur wenige Sekunden lang sind. Erzeugt werden die Videos nach der Eingabe von Text, Bild oder beidem.

IDG

Für die Erstellung von Bildern stehen unter anderem Midjourney, Dall E, Adobe Firefly und Dreamstudio zur Verfügung.

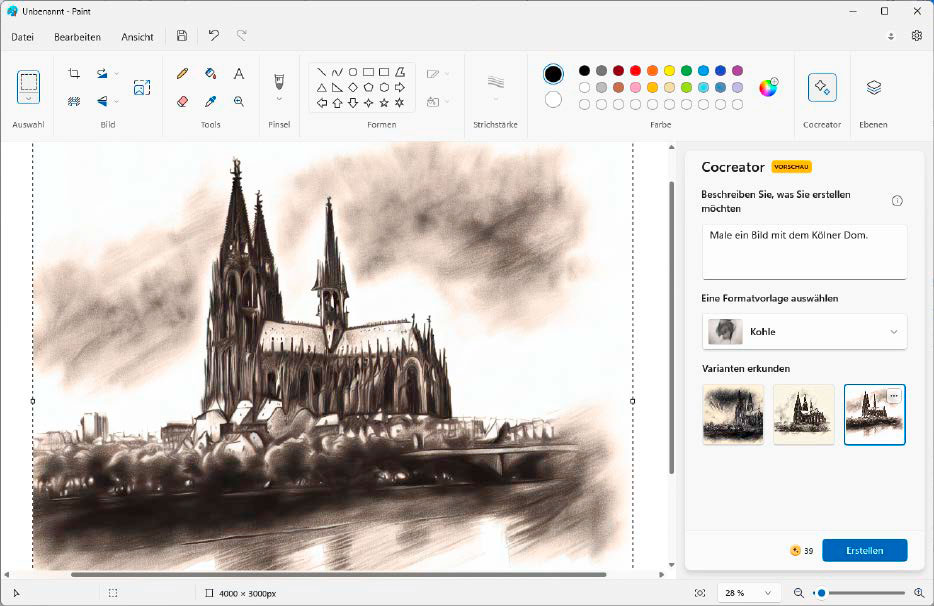

Diese sind meist kostenpflichtig. Kostenlos ist das Bordmittel Paint von Windows, das seit Anfang 2024 einen KI-Bildgenerator integriert hat (Befehl „Creator“ in der Menüleiste).

Für die Erstellung von Videos gibt es unter anderem Runway Gen 2, das aus einer Texteingabe oder einem Ausgangsbild ein Video erstellt. Hey Gen erstellt einen Avatar auf der Grundlage eines kurzen Videos von Ihnen. Das neue Lumiere von Google wird hoch gelobt, ist aber noch nicht öffentlich nutzbar.

Neue Musik lässt sich etwa mit dem Tool Stable Audio erstellen. Musiker werden mit den Ergebnissen meist nicht zufrieden sein.

Hier hat das Windows-Programm Paint den Kölner Dom als Kohlezeichnung erstellt. Die Berechnung erfolgte allerdings auf Internetservern von Microsoft, auch wenn das Programm lokal installiert ist.

IDG

6. Was unterscheidet generative KI von anderen Formen der KI?

Generative KI ist eine spezielle Form der künstlichen Intelligenz. Ihr Ziel ist es, neue kreative Inhalte zu schaffen, zum Beispiel in Form von Texten, Bildern oder Musik. Dazu nutzt sie gelernte Daten und Muster.

Im Gegensatz dazu sind traditionelle KI-Systeme hauptsächlich darauf ausgelegt, Daten zu analysieren, Muster zu erkennen und Ergebnisse vorherzusagen. Sie werden auch als regelbasierte KI bezeichnet, denn sie arbeiten häufig mit einem festen Regelwerk, um Schlussfolgerungen zu ziehen oder Entscheidungen zu treffen.

Diese Regeln müssen von Experten manuell erstellt und in das System implementiert werden. Solche Systeme werden beispielsweise in der medizinischen Diagnostik eingesetzt, um Bilddaten zu interpretieren. Auch im Finanzwesen gibt es Expertensysteme, die mit regelbasierter KI arbeiten.

Siehe auch: KI fürs Smartphone – 12 faszinierende Apps im Überblick

7. Was unterscheidet Cloud-KI von lokaler KI?

Die oben genannten KI-Tools laufen alle in der Cloud. Die einzige Ausnahme ist GPT4All, das es für den Windows-PC gibt. Der Grund dafür sind die hohe Hardwareanforderungen der großen Sprachmodelle. Sie benötigen sehr viel Arbeitsspeicher und eine sehr hohe Rechenleistung, mehr als die meisten aktuellen PCs bieten.

Cloud-KI bedeutet nicht nur, dass die KI auf Servern im Internet läuft, es heißt auch, dass jede Frage, die Sie der KI stellen, ins Internet geladen wird. Das ähnelt sehr einer Eingabe in eine Suchmaschine, bei der auch alle Eingaben auf dem Server der Suchmaschine landen.

In diesem Jahr planen mehrere PC-Hersteller, neue Rechner mit KI-tauglicher Hardware herauszubringen. Hier soll die KI auf dem lokalen PC laufen. Dieser bietet mindestens 16 GB Arbeitsspeicher und eine CPU oder GPU, die besonders für KI-Berechnungen geeignet ist. Welche Sprachmodelle und anderen KI-Tools dann sinnvollerweise auf diesen Systemen laufen werden, ist noch unklar.

8. Wem gehören die Inhalte, die eine KI erzeugt?

Generative KIs erzeugen Texte, Bilder, Musik und vieles mehr. Doch wem gehören diese neuen Werke? Der Firma hinter der KI? Oder demjenigen, der die KI nutzt? Oder gar all jenen, von dessen Werken die KI gelernt hat?

Tatsächlich ist diese Frage unbeantwortet. Das liegt vor allem daran, dass das Urheberrecht in Deutschland und den meisten anderen Ländern auf Menschen und nicht auf Maschinen zugeschnitten ist. Aktuell sieht beispielsweise die New York Times das Urheberrecht in Millionen ihrer Artikel verletzt und klagt gegen Open AI.

Aufgrund der aktuellen Rechtsunsicherheit geben etwa Open AI und Adobe ihren Großkunden eine Garantie, dass sie für rechtliche Schäden aufkommen, die durch Urheberrechtsklagen entstehen. Bis zur endgültigen rechtlichen Klärung der Urheberschaft von Inhalten generativer KI dürften noch einige Jahre vergehen.

9. Welche Gefahren gehen von generativer KI aus?

Generative KI birgt überraschend viele Gefahren. Das beginnt bei inhaltlichen Fehlern und Ungenauigkeiten in den Antworten der KI. Wer diese fehlerhaften Inhalte unkorrigiert verwendet, kann etwa in einer Prüfung ganz schön in die Bredouille kommen.

Auch die positive Eigenschaft der Produktivitätssteigerung durch KI birgt Gefahren, da viele Arbeitsplätze wegfallen könnten. Manipulation und Meinungsmache: Gefahren gehen auch von der Masse an Texten und Bildern aus, die sich heute in Sekundenschnelle produzieren lassen. Damit können Menschen manipuliert werden, zum Beispiel vor einer Bundestagswahl.

Deepfakes & Co: KI-generierte Inhalte könnten auch für Phishing-Angriffe genutzt werden, etwa per Mail, Telefon oder Video. Weltuntergang: Schließlich gibt es noch die Pessimisten, auch KI-Doomer genannt. Sie befürchten, dass KI zum Untergang der Menschheit führen wird. Die meisten Experten sind sich aber einig, dass es im Moment noch nicht so weit ist.

10. Wie sieht die Zukunft der generativen KI aus?

Kurzfristig wird erwartet, dass die aktuellen Modelle noch etwas besser werden. ChatGPT & Co. sollen weniger Fehler machen, mit aktuelleren Daten trainiert werden und noch besser ganz aktuelle Informationen aus dem Internet beziehen können. Bild- KIs wie Midjourney sollen besser darin werden, zum Beispiel Texte in ihren Bildern richtig darzustellen.

Im nächsten Schritt sollen die KIs selbstständig agieren können und dafür andere Werkzeuge nutzen dürfen. Ein Beispiel könnte das angekündigte KI-Smartphone der Telekom sein. Der Nutzer spricht nur noch mit der neuen KI, und diese führt die Aufgaben aus, indem sie diese in die Apps des Gerätes eingibt. Der Nutzer selbst soll mit den Apps nichts mehr zu tun haben.

Für viele KI-Forscher ist aber die allgemeine KI, auf Englisch Artificial General Intelligence (AGI), das große Ziel. Sie soll die gleichen oder gar bessere geistige Fähigkeiten haben wie der Mensch. Wie lange es noch dauern wird, bis wir eine solche KI bauen können, darüber gehen die Schätzungen auseinander.

Laut einer Umfrage unter KI-Forschern glauben nur wenige Teilnehmer, dass es nie gelingen wird, eine AGI zu bauen. 80 Prozent glauben, dass es noch in diesem Jahrhundert passieren wird. 50 Prozent rechnen Mitte des Jahrhunderts damit, einige sehen AGI noch schneller kommen. Mehr Infos zur Umfrage.